Неверные requests - частый источник либо перерасхода железа, либо нестабильности: контейнер думает, что ему положено больше, чем есть на ноде, и получает throttling или eviction.

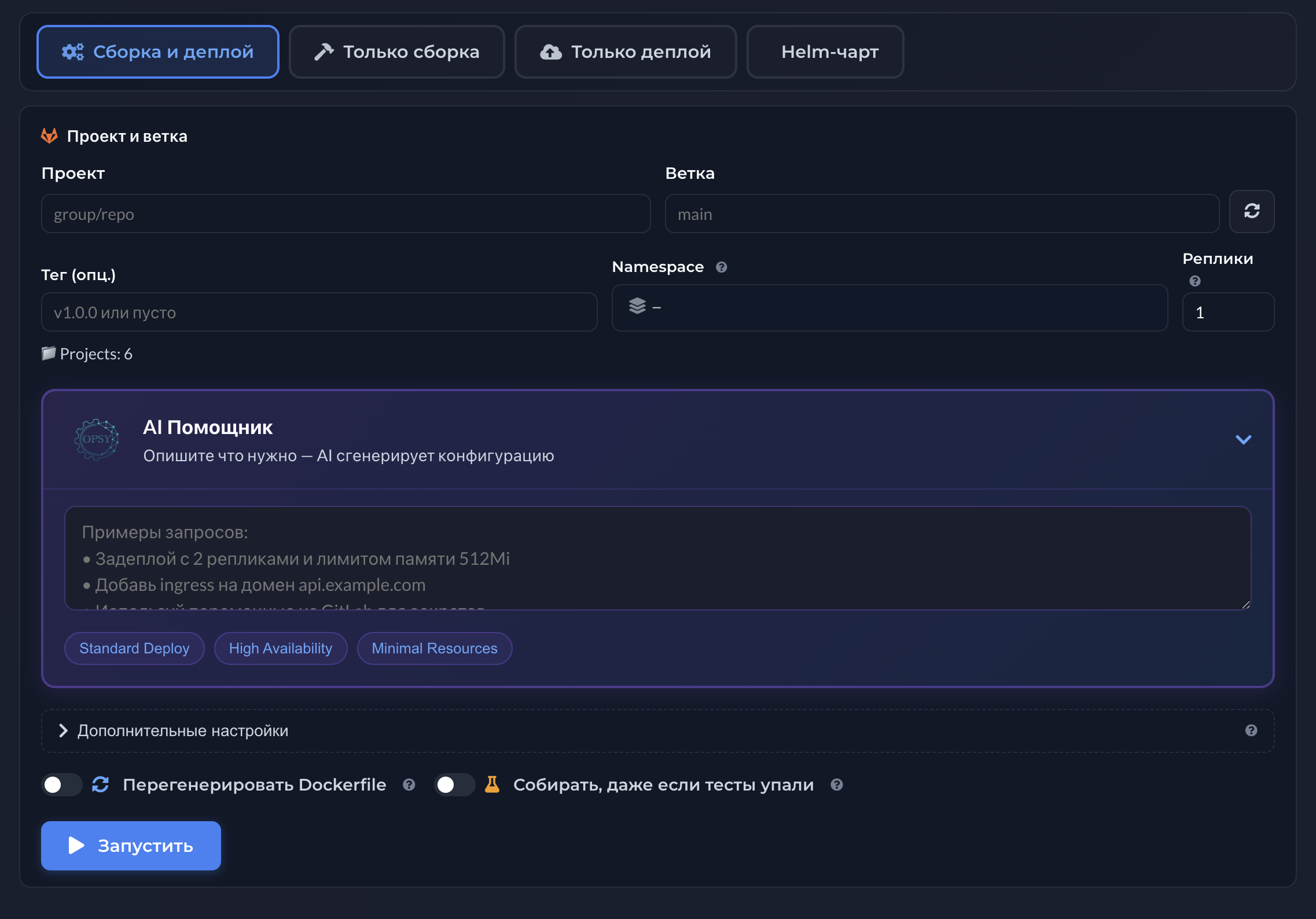

AI-рекомендации в Opsy задуманы как стартовая точка для инженерного решения, а не как автопилот. Команда сверяет предложения с профилем нагрузки, SLO и бюджетом; затем применяет изменения контролируемо.

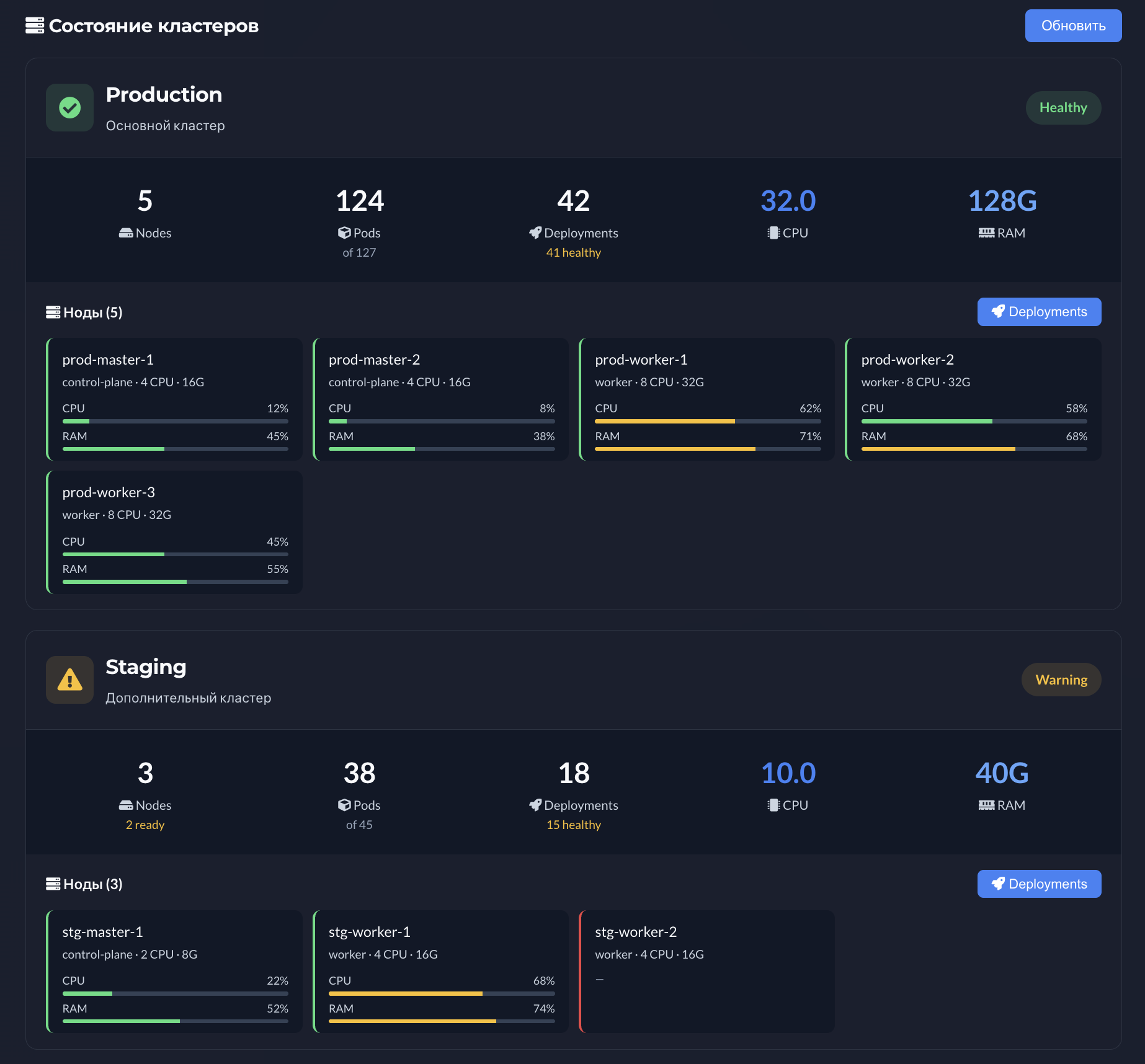

FinOps и разработка часто говорят на разных языках: одни смотрят на счета, другие - на латентность. Общая картина потребления (см. мониторинг и метрики) и предлагаемые диапазоны помогают договориться без взаимных обвинений.

Цикл оптимизации requests и limits в Kubernetes

Собрали метрики → выявили ворклоады с явным запасом или наоборот с риском → сформировали гипотезу → прогнали нагрузочный или канареечный тест (см. AI-деплой) → закрепили новые лимиты. Платформа ускоряет шаги до гипотезы.

Риски right-sizing: throttling и OOM-kill

Слишком агрессивное урезание CPU может ухудшить время ответа; слишком низкий memory limit - убить Pod при пике. Поэтому важны наблюдение после изменения и возможность быстрого отката.

Ключевые моменты

- Подсказки по CPU и памяти на основе наблюдаемого поведения

- Меньше «запас на глаз» и лишней стоимости кластера

- Снижение риска OOM и нестабильности из-за заниженных limits

- Общий язык для инженеров и FinOps

- Встраивается в процесс ревью изменений инфраструктуры

- Сочетается с мониторингом и историей релизов

- Особенно полезно при росте числа сервисов с типовыми паттернами